ChatGPT está integrado con DALL-E, uno de los mejores creadores de imágenes con IA de la actualidad (desde mi punto de vista solamente superado por Midjourney). Eso le da una ventaja enorme, ya que podemos crear una imagen y pedir modificaciones en el mismo chat, algo que no es posible hacer con la competencia de forma tan sencilla.

En este artículo os mostraré un paso a paso de cómo podemos utilizar esa ventaja para crear contenido único de forma mucho más sencilla que con Midjourney, pero antes de nada os recuerdo que todo lo que voy a hacer aquí también se podría hacer con Midjourney, pero usando –seed y otros trucos no tan obvios.

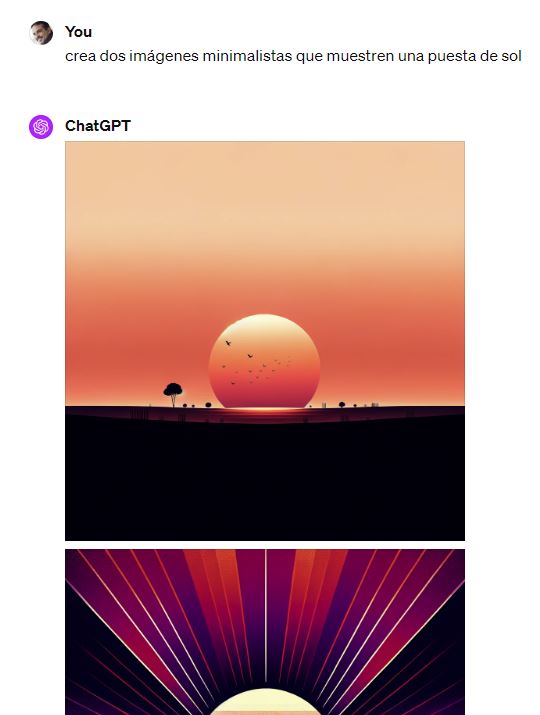

Lo primero que hacemos es pedir a ChatGPT una imagen, como una puesta de Sol, por ejemplo:

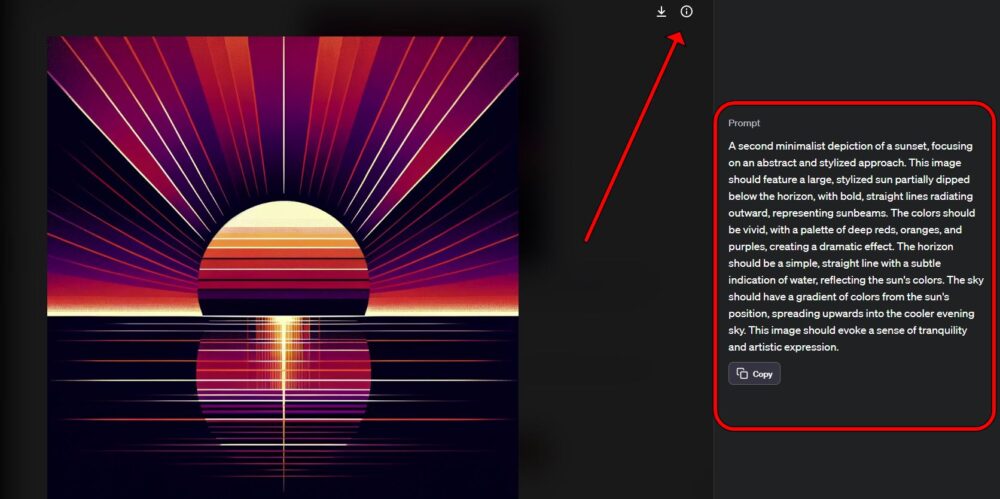

Ahora pulsamos en la imagen que nos ha gustado y obtenemos su prompt único:

=> Recibir por Whatsapp las noticias destacadas

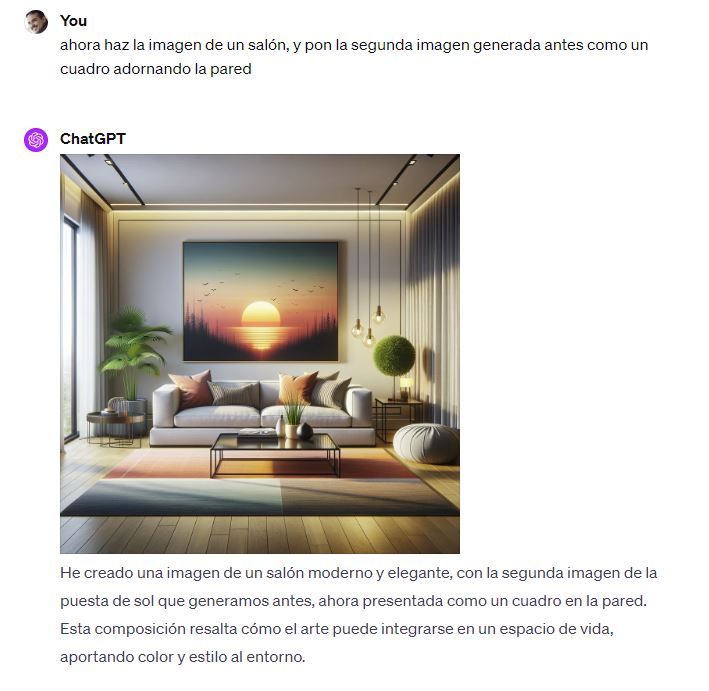

Con este prompt podemos pedirle a ChatGPT que integre la imagen en otra, de esta forma:

Como veis, el resultado no es perfecto, pero si no lo hacéis de esta forma, la imagen generada sería bastante distinta:

Por qué no consigue replicar exactamente la misma imagen

La generación de imágenes a través de herramientas como DALL-E, que se utiliza en conjunto con ChatGPT, se basa en algoritmos de inteligencia artificial que crean nuevas imágenes a partir de descripciones textuales. Cada vez que se solicita una imagen, el modelo genera una interpretación única basada en el texto proporcionado. Hay varias razones por las que ChatGPT no puede replicar exactamente una imagen previamente generada dentro de otra imagen:

- Procesos estocásticos: Los modelos de generación de imágenes, como DALL-E, operan de manera estocástica, lo que significa que incluso con el mismo prompt, las imágenes generadas pueden tener variaciones. Cada generación es un proceso único y no una reproducción exacta.

- Limitaciones técnicas: Actualmente, la tecnología no permite que ChatGPT recuerde o acceda directamente a imágenes generadas previamente. No puede «ver» o «recordar» imágenes; solo puede generar nuevas imágenes basadas en descripciones textuales.

- Complejidad de la generación de imágenes: Incluir una imagen específica previamente generada dentro de una nueva imagen es un desafío técnico significativo. Requeriría que el modelo identifique, copie y coloque con precisión una imagen exacta dentro de otra, lo cual está más allá de las capacidades actuales de los modelos generativos.

- Diseño del modelo: Estos modelos están diseñados para generar contenido creativo y único en lugar de replicar o duplicar imágenes existentes. Su principal función es interpretar y transformar descripciones textuales en representaciones visuales.

¿Y si ponemos ese prompt de antes en Midjourney?

Para dejar claro cómo es la IA generativa, vamos ahora a poner esa misma descripción en Midjourney, obteniendo un resultado completamente diferente, auque sea el mismo prompt.

Es importante conocer todo esto para ender cómo funciona la generación de imágenes. No es Photoshop, no es una edición tradicional, es jugar con lo aleatorio, esperando resultados que, en la gran mayoría de las veces, no es como el que teníamos en la cabeza.

Fuente: Link