El científico danés Sune Lehmann lideró el desarrollo de un algoritmo capaz de intuir los grandes sucesos de la vida de una persona hasta el último aliento. En una entrevista con Infobae, explicó cómo funciona y qué objetivo persigue. Especialistas en IA opinaron sobre cuáles deben ser los límites morales en los avances de la tecnología.

Sune Lehmann, líder del equipo que creó un algoritmo capaz de predecir distintos eventos de la vida de una persona

Sune Lehmann, líder del equipo que creó un algoritmo capaz de predecir distintos eventos de la vida de una persona

Fuente: Infobae

“Si pudieras conocer la fecha de tu muerte, ¿preferirías saberlo o continuar tu vida con esa incertidumbre?”. Lo que supo ser un juego, el puntapié inicial para habilitar una discusión sobre un planteo improbable, hoy es una posibilidad tangible gracias -o pese- al avance frenético de la inteligencia artificial. La tecnología, se demostró, puede predecir con una efectividad sorprendente cuándo morirá una persona.

Sune Lehmann es el principal responsable de Life2Vec, un desarrollo que encendió las alarmas por su potencial tétrico. Es que el algoritmo no solo es capaz de predecir muertes prematuras -y lo hace con un 78% de acierto-, sino que también puede estimar distintos “eventos de vida” de los participantes tales como su éxito profesional, si formará una familia o si se mudará de ciudad.

=> Recibir por Whatsapp las noticias destacadas

Lehmann originalmente es físico, pero desde hace años se decantó por la informática. Es profesor de Redes y Ciencias de la complejidad en la Universidad Técnica de Dinamarca. También enseña Ciencias de datos sociales en la Universidad de Copenhague. Su trabajo se centra en la comprensión y desarrollo de tecnologías de aprendizaje automático a partir de datos masivos.

“Tuve la idea de este proyecto como parte de una subvención apuntada a comprender el papel de las conexiones sociales en la determinación de los resultados de vida de las personas. Pero para comprender el papel de las redes, primero tuvimos que reconocer cómo predecir mejor los resultados de vida de los individuos. Mi idea en principio fue lograr la mejor predicción posible para los grandes eventos individuales”, dijo en una entrevista con Infobae.

El grupo de investigación que lidera busca entender el mundo a partir de grandes conjuntos de datos, sobre todo el entorno social y el comportamiento colectivo de las personas. Para ello se sirvieron de la tecnología detrás de los grandes modelos de lenguaje (LLM por sus siglas en inglés), una red neuronal capaz de aprender a partir de múltiples parámetros en formato de textos.

A ese algoritmo le cargaron la base de datos anonimizada de alrededor de seis millones de daneses, recopilados por la agencia oficial Statistics Denmark. A partir del análisis de una secuencia de acontecimientos, la IA predice eventos de la vida hasta el último aliento. Los resultados, publicados en la revista científica Nature, muestran que a la hora de predecir una muerte, por caso, el algoritmo acierta en el 78% de los casos. Mismo cuando se le pide que vaticine si una persona se mudará a otra ciudad o país, lo hace correctamente en el 73% de los casos.

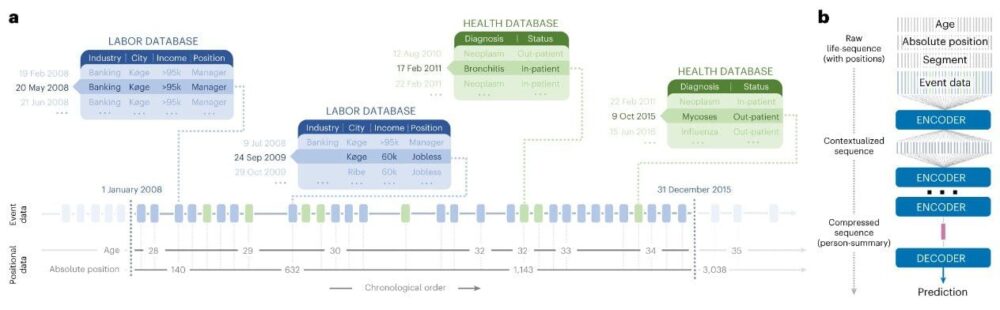

El entramado complejo de cómo se alimenta el algoritmo con datos socioeconómicos y de salud para arribar a predicciones

El entramado complejo de cómo se alimenta el algoritmo con datos socioeconómicos y de salud para arribar a predicciones“Descubrimos que al organizar los acontecimientos de las vidas humanas en una secuencia del siguiente modo: nacer en este lugar, con este peso al nacer, vivir en este lugar, comenzar en este jardín de infantes, etc., se pueden crear modelos usando un método matemático. Al tipo de modelo lo llamamos ‘transformadores’, que construyen a su vez representaciones del mundo”, explicó Lehmann.

一¿Cómo se alimenta y funciona el algoritmo? ¿Cuáles son los datos esenciales que le hacen llegar a tal o cual conclusión?

一Así como los modelos de lenguaje usan las matemáticas para estimar las probabilidades de elegir cierta palabra, nuestros modelos usan la misma técnica para estimar las probabilidades de cierto evento de la vida. Le mostramos muchos ejemplos de los resultados que queremos distinguir y lo entrenamos para que aprenda los patrones de las secuencias de cada resultado. Lo importante desde una perspectiva de investigación es que el modelo matemático que estima las probabilidades es, en sí mismo, interesante. Es un objeto matemático que representa todas las relaciones entre cosas que pueden suceder en la vida humana. Es por eso que llamamos a nuestro modelo “modelo básico” en el artículo.

一En el caso particular de la predicción de la muerte, ¿cómo lo entrenaron?

一En el caso de predecir la muerte, le mostramos al algoritmo muchos ejemplos de personas que viven y muchos ejemplos de personas que mueren y lo entrenamos para que detecte los patrones que distinguen esos resultados. En este momento el modelo utiliza datos del mercado laboral y algunos datos de salud.

一¿Qué datos se tienen en cuenta? O, más bien, ¿cuáles son las variables más importantes a la hora de llegar a una predicción?

一Esto es lo bueno de nuestro modelo. Debido a que es un modelo básico de todos los eventos de la vida de una persona, simplemente lo entrenamos para que reconozca la diferencia entre los resultados y el modelo “descubre” cuáles son las variables relevantes dentro de esas secuencias de vida. En todos los demás modelos tienes que decidir qué datos quieres usar para la predicción. Nosotros simplemente los usamos todos.

一¿No puede haber sesgos peligrosos allí?

一Efectivamente el modelo tiene sesgos. Y estoy de acuerdo en que hay que tener cuidado con los sesgos de los algoritmos. Pero recuerda que nuestro modelo no sirve para nada. Es un proyecto de investigación. Entonces, parte de lo que nos interesa ahora es analizar y comprender esos sesgos. Y al mismo tiempo nos dice algo sobre la sociedad.

Lehmann pensó Life2Vec como un proyecto de investigación sin aplicaciones, por ahora, en el mundo real

Lehmann pensó Life2Vec como un proyecto de investigación sin aplicaciones, por ahora, en el mundo realAquí hay un punto central. Life2Vec, la herramienta que predice, entre otros sucesos de vida, la fecha de muerte de una persona, es por ahora un proyecto de investigación que pretende justamente comprender el potencial de los modelos de lenguaje construidos con IA. El sistema no está listo para usarse por fuera del ámbito de investigación. Lehmann y sus colegas quieren explorar los resultados a largo plazo, identificar cuál es el impacto que tienen las conexiones sociales en la vida y la salud. Están enfocados en sumar cada vez más datos -redes sociales entre ellos- para ver cómo responde el algoritmo.

一No sé para qué servirá el modelo 一dijo el científico一. Hay ciertos usos que nunca deberían ocurrir (y que son ilegales), como la predicción de delitos. Pero hay oportunidades en el sector de la salud en los que creo que el modelo podría ser muy útil una vez que enfrentemos los prejuicios.

一¿Hacia dónde cree que se dirige la inteligencia artificial? ¿Hacia avances éticamente indeseables?

一No lo tengo claro, pero seguramente habrá muchos problemas una vez que comencemos a implementar la IA como parte de la sociedad. Será un desafío enorme hacerlo de una manera justa y equitativa. Las grandes empresas tienen sus cañones apuntando a la IA generativa. La cantidad de dinero que se destina al poder computacional es una locura en este momento.

¿Cuáles son los principios éticos que deberían regir la IA?

El desarrollo de Life2Vec reavivó un debate en torno a los principios éticos que deberían regir los desarrollos en inteligencia artificial

El desarrollo de Life2Vec reavivó un debate en torno a los principios éticos que deberían regir los desarrollos en inteligencia artificialLa discusión en torno al potencial de la inteligencia artificial abre un sinfín de aristas. Uno de ellos es si hay -o debería haber- principios éticos detrás de la tecnología, que orienten su porvenir y favorezca desarrollos que no conspiren contra los humanos. Infobae consultó con expertos que dieron su mirada respecto a los lineamientos que deberían regir la IA.

Simon Kolstoe, profesor de Bioética de la Universidad de Portsmouth, Inglaterra, trazó un paralelismo entre la ética médica y tecnológica. Según él, son cuatro los principios: beneficencia (beneficios), no maleficencia (evitar daños), autonomía (libre elección para los individuos) y justicia (derecho a apelar decisiones basadas en IA).

Los modelos actuariales como los que utilizan las compañías de seguros intentan predecir desde hace décadas el futuro de una persona. El hecho de identificar posibles predictores sólidos no es particularmente novedoso, aunque hasta el momento no existía una tecnología que pudiera hacer predicciones con semejante efectividad. La inteligencia artificial lo hizo posible a partir de su capacidad de procesar millones de datos y de aprender en forma automática y permanente.

El filósofo David Weitzner, profesor de la Universidad de York, Canadá, se especializa en ética de los negocios. Él cree que el principio ético que debería regir, por encima de todo, el desarrollo de la IA es el mismo principio que aplica a innovaciones empresariales: total transparencia en cuanto al plan de negocio y al modelo de creación de valor.

“¿Están ganando dinero explotando lagunas en la infracción de derechos de autor para generar textos/imágenes para consumidores que piensan que el resultado es totalmente suyo? ¿Están ofreciendo un producto presentado como complemento de la IA, pero están ganando dinero con la vigilancia subrepticia, la extracción de datos y la ingeniería social? ¿O están ganando dinero con los ingresos por ventas de su algoritmo predictivo patentado, que hace exactamente lo que dice que hará, aunque la tecnología sea imperfecta? Nuestra sociedad debería tener un gran problema con los dos primeros modelos de negocio, pero no con el tercero”, remarcó.

En su próximo libro Thinking Like a Human: The Power of Your Mind in the Age of AI, Weitzner sostiene que una característica esencial de la experiencia humana es la elección y se opone a entregar nuestro futuro a empresas que esperan construir un mundo determinista de predicción absoluta sin libre albedrío.

Marcel O’Gorman, director del Critical Media Lab de la Universidad de Waterloo, se dedica a investigar innovaciones responsables dentro del ecosistema tecnológico. Él coincide en que la transparencia es imperativa a la hora de emprender desarrollos en IA. Las empresas con mayor financiación no tienen ninguna obligación de revelar cómo funciona su sistema, qué contienen sus conjuntos de datos y cuáles son sus motivaciones finales, además de obtener ganancias.

“El concepto de ‘IA abierta’ es una broma. La empresa puede lanzar un producto al público sin previo aviso y sin tener en cuenta la seguridad pública, todo sin explicar abiertamente sus intenciones o cómo se construyó la tecnología. Como resultado, no tenemos forma de predecir los resultados dañinos de una tecnología de IA, ni de monitorear los conjuntos de datos en busca de sesgos o robo de propiedad intelectual, ni de entender si la IA se está utilizando para manipular a los individuos o para causar otros daños”, marcó.

¿Se puede regular la IA?

Las legislaciones existentes no llegan a regular los avances vertiginosos de la IA

Las legislaciones existentes no llegan a regular los avances vertiginosos de la IADennis Hirsch, profesor de Derecho y Ciencias de la Computación en la Universidad Estatal de Ohio, Estados Unidos, considera que tecnologías con el potencial de Life2Vec pueden traer grandes beneficios a la humanidad, pero también plantean amenazas. Por caso, las predicciones basadas en inteligencia artificial sobre el éxito profesional de una persona pueden estar sesgadas por raza o género, y de ese modo perpetuar las desigualdades actuales.

“Las regulaciones deberían exigir que las organizaciones consideren seria y enérgicamente todos los impactos de una tecnología de IA y la desarrollen e implementen solo cuando sean responsables de ello. La mayoría de las regulaciones actuales siguen este enfoque”, advirtió el experto.

Los requisitos de evaluación de la conformidad de la ley de IA de la Unión Europea, por ejemplo, exhorta a contemplar los posibles de impactos de cada desarrollo. No obstante, ninguna ley resultará suficiente para garantizar que no haya excesos. “Tales regulaciones por sí solas son insuficientes. Necesitamos normas que detallen qué prácticas son socialmente aceptables y cuáles no, pero estamos muy lejos de eso”, afirmó Hirsch.

Según Weitzner, la legislación más importante sería consagrar los derechos sobre los datos. Cree que las Big Tech han ignorado una y otra vez las normas de privacidad y de derechos de autor, considerando cada pieza de producción humana como datos para ser extraídos. “En casos como este, donde toda una industria se niega a autorregularse, necesitamos que el gobierno intervenga y proteja los derechos de los creadores y consumidores”, sostuvo.

Por su parte, O’Gorman piensa que, en primer lugar, se debería exigir que los productos de las empresas de IA se sometan a auditorías por parte de organizaciones externas que prueben su transparencia, equidad y responsabilidad pública. Esos auditores, cree, tienen que ser financiados por los gobiernos y monitoreados para detectar casos de corrupción.

“No se debe permitir que las empresas de inteligencia artificial tengan más poder que las naciones a las que venden sus productos. Desafortunadamente, esta asimetría de poder hoy existe y las burocracias no llegan a mantenerse al día con la velocidad vertiginosa del tecnocapitalismo. Tenemos muchas directrices, manifiestos y declaraciones para ayudar a guiar el desarrollo de una ‘IA responsable’. Pero a menos que estos documentos bien intencionados vayan acompañados de un proceso de regulación aplicable, no son más que declaraciones de supuesta ética”, remarcó.