Está compuesto por un decodificador de imagen convolucional 2D, un generador de representación latente convolucional 3D y un generador de video. El decodificador de imágenes asigna cuadros de videos de destino a un espacio latente, mientras que el generador de representación latente aprende a incorporar la información contenida en los cuadros de entrada. Finalmente, el generador de video decodifica la representación latente en cuadros de video.

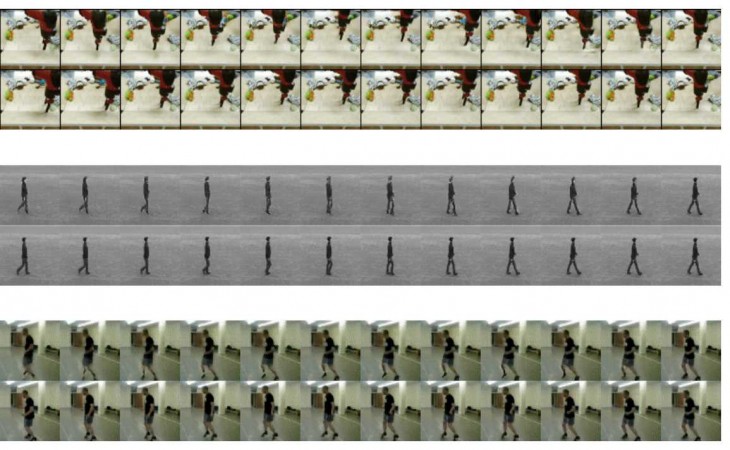

Los investigadores obtuvieron videos de tres conjuntos de datos y los muestrearon a una resolución de 64 x 64 píxeles. Cada muestra contenía 16 cuadros en total, 14 de los cuales fue creado por el sistema AI. Los investigadores ejecutaron el modelo 100 veces para cada par de cuadros de video y repitieron el proceso 10 veces para cada variante de modelo y conjunto de datos, algo que duró 5 días con una tarjeta gráfica Nvidia Tesla V100.El estudio puede consultarse en este PDF, donde pueden verse imágenes como la de la captura superior.Fuente: https://wwwhatsnew.com