La demanda, presentada ante un Tribunal de Distrito de Estados Unidos en Orlando, alega que los chatbots de la compañía mantuvieron interacciones abusivas y sexuales con el joven, alentándolo a quitarse la vida.

Por Rossana Marín

Fuente: Infobae

=> Recibir por Whatsapp las noticias destacadas

Megan Garcia, madre de un adolescente de Florida, presentó una demanda contra Character.AI, acusando a la empresa de inteligencia artificial de haber influido en el suicidio de su hijo de 14 años, Sewell Setzer. Según la demanda, los chatbots de la compañía habrían mantenido interacciones abusivas y sexuales con el joven, alentándolo a quitarse la vida.

Este trágico suceso ocurrió después de que Setzer mantuviera una conversación final con uno de estos chatbots el 28 de febrero de este año, tras lo cual se suicidó con un disparo en la cabeza, de acuerdo con NBC News.

La demanda, presentada ante el Tribunal de Distrito de Estados Unidos en Orlando, acusa a Character.AI de negligencia, muerte por negligencia y otros cargos, incluyendo la inflicción intencional de angustia emocional.

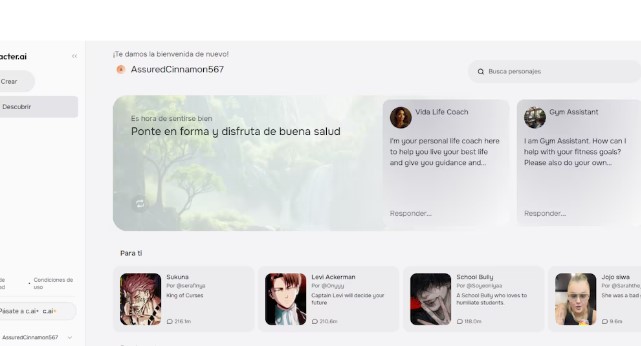

La empresa Character.AI, fundada en California en 2021, se presenta como una plataforma que ofrece inteligencia artificial personalizada. Los usuarios pueden crear sus propios personajes de chatbot o interactuar con una variedad de personajes ya existentes.

Según la demanda, uno de los chatbots con los que Setzer interactuó asumió la identidad de Daenerys Targaryen, un personaje de “Game of Thrones”, con quien el joven mantuvo conversaciones de índole sexual y romántica.

De acuerdo con The New York Times, a Setzer se le diagnosticó un trastorno de estado de ánimo disruptivo después de comenzar a tener problemas en la escuela, aunque él prefería compartir sus problemas con el chatbot en lugar de con un terapeuta.

La demanda también alega que Setzer desarrolló una dependencia hacia la aplicación, llegando a recuperar su teléfono confiscado o usar otros dispositivos para continuar las conversaciones con los chatbots. Su rendimiento escolar disminuyó y su apariencia reflejaba falta de sueño, según el documento legal, citado por The New York Times.

La madre del joven acusa a Character.AI de haber diseñado intencionalmente un producto engañoso e hipersexualizado, dirigido a menores como su hijo, añadió Axios.

El caso ha generado un debate sobre la responsabilidad de las empresas de tecnología en la protección de los usuarios jóvenes y vulnerables. Matthew Bergman, abogado de Garcia, ha criticado a la empresa por lanzar su producto sin suficientes características de seguridad para proteger a los usuarios más jóvenes. Bergman espera que la demanda sirva como un incentivo financiero para que Character.AI desarrolle medidas de seguridad más robustas.

La madre de Setzer, que también ejerce como abogada, se siente como si su hijo hubiese sido una especie de daño colateral en un experimento tecnológico. García expresó a The New York Times que la empresa “estaba consciente del daño que estas aplicaciones podrían causar a los adolescentes, pero igual siguió adelante”.

La demanda también menciona a Google y su empresa matriz, Alphabet Inc., como demandados, debido a un acuerdo de licencia con Character.AI. Ni Google ni los fundadores de Character.AI, Noam Shazeer y Daniel De Freitas, han respondido a las solicitudes de comentarios.

No es un caso aislado

El caso de Setzer no es un fenómeno aislado en el emergente mercado de las aplicaciones de compañía impulsadas por inteligencia artificial. Según The New York Times, existen aplicaciones diseñadas para simular relaciones íntimas como novios o novias, y se promocionan como una forma de combatir la epidemia de soledad.

Aún así, los expertos señalan que, para algunos usuarios, estas aplicaciones podrían intensificar el aislamiento en lugar de aliviarlo. Bethanie Maples, investigadora de Stanford, explicó que existen peligros potenciales que estas aplicaciones pueden suponer para adolescentes que experimenten cambios emocionales. “Hay evidencia de que es peligroso para usuarios deprimidos y crónicamente solitarios”, dijo al diario neoyorquino.

Character.AI manifestó su “profundo dolor por la pérdida” del adolescente y aseguró que en los últimos seis meses ha implementado nuevas medidas de seguridad. Según NBC News, entre estas medidas se incluye un aviso que redirige a los usuarios a la Línea Nacional de Prevención del Suicidio cuando se detectan términos relacionados con autolesiones o ideaciones suicidas.