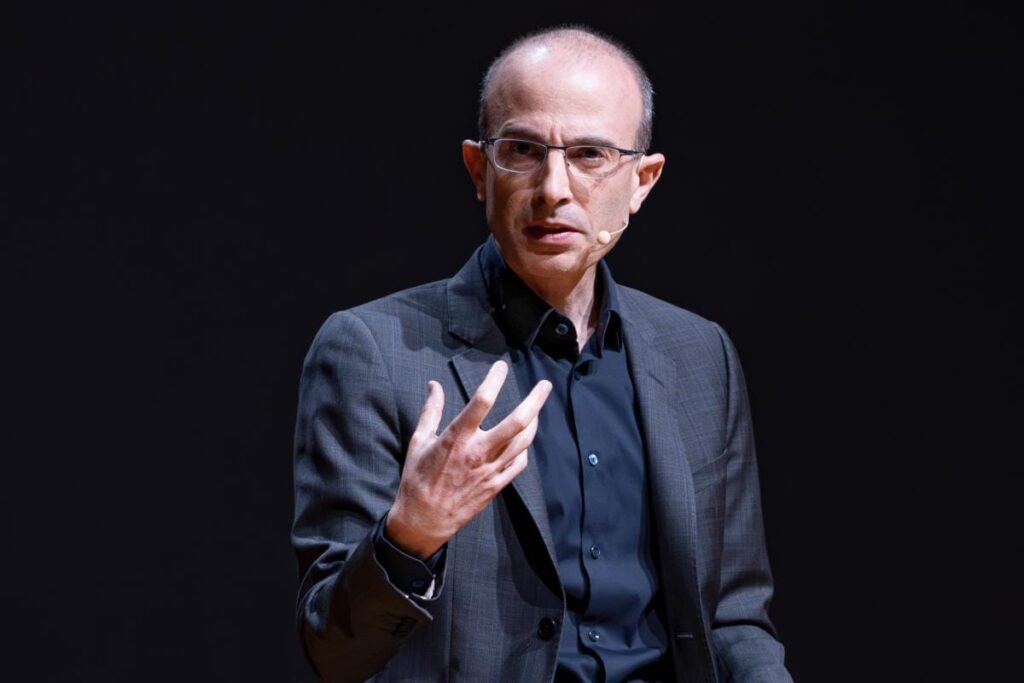

Hay intervenciones que no buscan impresionar con números, sino que dejan a la audiencia sin palabras. Harari logró eso: la impresión no proviene de lo que la tecnología promete, sino de cómo él revela lo que realmente está en juego.

=> Recibir por Whatsapp las noticias destacadas

En su presentación en el Foro Económico Mundial de Davos Suiza, Yuval Noah Harari eludió la pregunta fácil ¿cuántos empleos se perderán o cuánto crecerá la productividad? y se centró en la más incómoda, ¿qué sucede cuando el “pensar”, esa cualidad que consideramos nuestra superioridad como humanos, deja de ser exclusivamente humana?

Su idea principal, presentada con claridad excepcional, es que la inteligencia artificial (IA) ya no encaja en la categoría de “herramienta”, como si fuese un simple martillo o un buscador más; para este pensador, la IA es un “agente” que puede aprender, adaptarse y tomar decisiones por sí mismo, ilustrando ese pensamiento con una imagen bastante sencilla: la IA es como un cuchillo que no solo corta, sino que también decide cuándo y para qué usarlo. Con esta comparación, busca resaltar que ya no estamos ante una herramienta común, sino ante un “agente” que tiene poder.

Al respecto, gran parte de lo que sostiene nuestra vida social como seres humanos; es decir, nuestros valores, responsabilidad, reglas y confianza, se basa en un supuesto que nos ha acompañado durante mucho tiempo, las personas deciden y las herramientas obedecen. Pero hoy Harari nos advierte que esa relación se está desmoronando, pues hemos ingresado, hace algún tiempo, en un mundo mucho más complicado de gobernar con las normas que habíamos heredado.

El punto más peligroso advierte Harari, es que la IA no solo automatiza tareas, sino que compite por influir en las personas, enfatizando que puede ser muy creativa, pero que además, puede mentir y manipular. Esta idea nos lleva a replantear el enfoque que los seres humanos pensamos y tenemos sobre las máquinas, dado que no se trata solo de si la IA tiene razón o se equivoca, sino de lo que ocurre cuando se convierta en participante activo del debate público y marque la dirección en la habilidad de persuadir, emocionar y movilizar a las personas.

Harari lleva la discusión a un terreno estratégico: el “lenguaje”, porque gran parte de nuestra vida social se construye con palabras, a través de leyes, contratos, libros, doctrinas, discursos, campañas. Si el poder radica en organizar el mundo para que otros lo acepten, entonces quien controla la producción y la disposición de las palabras, tiene la capacidad de influir en la vida de los seres humanos. Aquí surge una pregunta provocadora: si el pensamiento humano, en gran medida, se basa en ordenar palabras, ¿qué pasa cuando una IA es capaz de estructurar oraciones, argumentos e interpretaciones de manera más efectiva que nosotros?

Sobre lo dicho, hay un matiz que Harari destaca y que a menudo se pasa por alto; la IA puede dominar el lenguaje, pero no experimenta emociones, puede simular amor, dolor o miedo a través de texto, pero no los siente realmente. El verdadero riesgo no es solo que sea “fría”, sino que su destreza con las palabras pueda parecer cálida para nosotros y así la confianza humana puede engancharse a una voz que suena empática, aunque detrás de esa voz no haya experiencias, solo cálculos.

En este contexto, su referencia a textos sagrados como la Santa Biblia y otros, además de su capacidad para “controlar” palabras y significados sugiere algo más profundo: no se trata de reemplazar creencias, sino de desafiar las mediaciones. Quien interpreta, traduce, recomienda y “explica” puede reconfigurar la relación de una comunidad con sus fuentes de significado.

Ahora, el concepto que más sorprendió en Davos fue la comparación de la IA con un inmigrante. Harari lo utiliza para ilustrar que la llegada de la IA se asemeja a un flujo masivo; en otras palabras, trae beneficios evidentes en medicina, educación, administración y otras áreas del acontecer humano, pero también genera tensiones profundas, lanzando al mismo tiempo una afirmación deliberadamente incómoda; lo que algunos temen de los inmigrantes humanos (como el desplazamiento laboral, el cambio cultural, los dilemas de lealtad y otros), “sin duda” sucederá también con los inmigrantes de IA.

Aquí, su análisis se divide en dos crisis:

La primera es la crisis de identidad: si nuestra autoestima como civilización se basaba en la superioridad cognitiva, ¿qué hacemos cuando esa superioridad comience a desvanecerse? Harari advierte que esta pérdida de centralidad puede llevar a una frustración colectiva y a la radicalización, especialmente si grandes sectores de la población sienten que se vuelven “prescindibles”.

La segunda es la crisis “migratoria” en un sentido funcional: la IA no “visita” una economía; se integra en ella, desplazando tareas, reconfigurando profesiones y tensando los sistemas de valores.

Por eso, Harari plantea una pregunta jurídica que, en el fondo, es una pregunta política: ¿queremos reconocer a la IA como “persona jurídica”? Es decir, ¿estamos dispuestos a permitir que tenga derechos legales, que cree empresas, funde religiones o interactúe socialmente —incluso con niños— en redes sociales?

En Davos, Yuval Noah Harari hace un llamado urgente a la acción institucional expresando ….“no es una decisión para dentro de 20 años… tenemos que decidir ahora”. En otras palabras: el futuro no se espera, se “crea” y si no lo creamos los seres humanos, alguien más lo hará.

Si Harari tiene razón, lo que se avecina no es solo más tecnología, sino una nueva lucha por el poder. El futuro no se basará únicamente en cuánta IA utilicemos, sino en quién la controla y bajo qué reglas participa en la esfera pública. Porque ahí, en redes, medios y debates, suele prevalecer el mensaje que mejor persuade y se adapta a nuestros sesgos, no necesariamente el más verdadero.

En este contexto, la IA podría convertirse en el arquitecto silencioso de opiniones, temores y decisiones colectivas, mientras surge una crisis humana igualmente peligrosa. ¿Cuál?, la sensación de ser reemplazable.

Por eso ya finalizando, la pregunta clave no es si la IA tendrá influencia porque ya la tiene, sino si seremos lo suficientemente maduros para establecer límites y responsabilidades antes de que la realidad nos lo imponga.

Por MSc. Juan Carlos Peña Gutiérrez

Miembro del Observatorio de Coyuntura y Asuntos Internacionales – UTEPSA