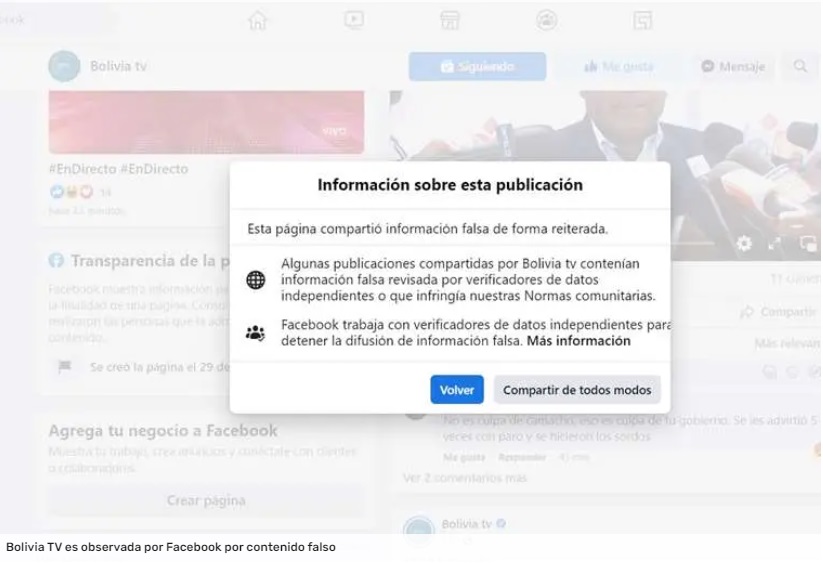

Una ventana emergente aparece cada que un usuario busca compartir una publicación del canal estatal boliviano. Facebook verifica contenidos a través de personas, empresas e inteligencia artificial.

Tanya Imaña Serrano

Fuente: El Deber

Facebook alerta a sus usuarios que desean compartir un post de la página de Bolivia TV que : “esta página compartió información falsa de forma reiterada. Algunas publicaciones compartidas por Bolivia tv contenían información falsa revisada por verificadores de datos independientes o que infringía nuestras normas comunitarias. Facebook trabaja con verificadores de datos independientes para detener la difusión de información falsa”.

Además, da la opción de volver a la página o de: “compartir de todos modos”.

Juan Pablo Vásquez, especialista en tecnología de consumo y profesional, explicó a EL DEBER que Facebok ha endurecido sus políticas para restringir contenidos desde 2016 y que realiza verificación permanente a través de personas, empresas e inteligencia artificial. Los temas críticos de verificación para esa red social son la salud y la política.

“Bolivia TV es muy política, es normal que estén en el ojo de la tormenta”, señala. Si bien el cuadro de advertencia se refiere a normas comunitarias, Vásquez indica que, por lo general, las más críticas tienen que ver con racismo y violencia, y también con información falsa, aunque no se sabe con exactitud, cuál norma habría violado la televisora estatal.

El experto manifiesta que, además, la página probablemente pudo haber tenido varias denuncias; es decir, que muchas personas la hubieran reportado.

Vásquez explica que Facebook restringe para evitar que se viralice. “La meta de Facebook es no censurar, pero sí evitar que se viralice”.

De manera que esta alerta aparece como una suma del tipo de publicaciones consideradas como falsas por Facebook, después de haber realizado verificaciones y, probablemente, por las denuncias recibidas de usuarios.

Vásquez expresa que aunque no es fácil, esta situación puede ser revertida, pero que deberá cumplir con diversos requisitos. Solo como ejemplo, señala que para publicar anuncios políticos, Facebook pide no solo identificación, sino también el envío de otros documentos que acrediten que se trata de una persona real. Así que para ‘limpiar’ la página se deben pasar varios filtros, como demostrar que no es negativa, que no hace daño, etc.

Lo que dice Meta

Facebook se precia de luchar contra la “información errónea”, la que describe como: “afirmaciones falsas comparables, en particular, que podrían causar engaños o perjuicios”, que incluyen videos, imágenes, enlaces y publicaciones solo de texto.

“Cuando los verificadores de datos califican un contenido como falso o alterado, reducimos drásticamente su distribución y aplicamos las etiquetas de advertencia más estrictas”, señala el documento referido al Programa de verificación de datos independiente de Meta.

Meta, la empresa dueña de Facebook, Instagram y Whatsapp, clasifica el contenido, no solo como falso o alterado, sino también como parcialmente falso y otra categoría es la de contenido con falta de contexto.

“El contenido calificado como parcialmente falso incluye ciertas imprecisiones. En consecuencia, reducimos la distribución de este contenido, pero en menor medida que cuando se trata de contenido calificado como falso o alterado. En el caso de contenido calificado como falta de contexto, nos centraremos en obtener más información por parte de nuestros socios de verificación de datos”, explica más adelante.

Luego hace referencia de lo que sucede en el caso de la página de Bolivia TV en Facebook:

“Cuando alguien intenta compartir una publicación calificada por un verificador de datos, le mostramos un aviso emergente para que pueda decidir por sí mismo qué leer, en qué confiar y qué compartir”.

El impacto para estas páginas que publican información observada por Facebook, va más allá de la distribución de sus contenidos, le afectará a la parte económica, como la monetización y los anuncios.

“Tomamos medidas con respecto a páginas y dominios que comparten o publican contenido que se califica como falso o alterado de forma reiterada. Se reducirá la distribución de estas páginas y estos dominios perderán su capacidad de monetizar y anunciarse, y no podrán registrarse como páginas de noticias en Facebook. Con el tiempo, las páginas y los dominios pueden recuperar el nivel de distribución y la capacidad de monetizar y anunciarse si dejan de compartir información errónea”, explica el documento.

Sobre la verificación de datos, Meta indica que sigue tres pasos:

-Identificar. “Identificamos la posible información errónea, mediante diversas señales y nuestros socios de verificación de datos también pueden detectar contenido de forma proactiva por su cuenta”.

-Revisar. “Los verificadores de datos revisan las historias y las califican según su precisión a través de informes originales, incluidas entrevistas con las fuentes principales, consultas de datos públicos y análisis de archivos multimedia, como fotos y videos”

-Actuar. “Una vez que el socio de verificación de datos califica el contenido, mostramos a los usuarios artículos de verificación de datos en nuestras plataformas y colocamos etiquetas en la parte superior de las noticias falsas. De este modo, nos aseguramos de que menos personas vean esa información errónea”.